AI-Native PRD, LLM-as-a-Judge... Automatisez l'évaluation de vos fonctionnalités d'IA !

Contrairement à un logiciel classique, une feature IA ne produit jamais deux fois exactement le même résultat.

On ne peut pas garantir qu'elle fonctionnera à chaque fois, seulement qu'elle fonctionne suffisamment souvent, sur les bons cas, avec un niveau de qualité acceptable.

Ça, les tests classiques ne savent pas le mesurer.

L'AI Eval Playbook vous donne deux outils complémentaires : un template de PRD IA pour cadrer votre feature avec rigueur, et un framework pour mettre en place un LLM-as-a-Judge qui évalue les résultats, du test hors ligne au monitoring en production.

Passez vos cas d'usage IA à l'échelle en toute sécurité !

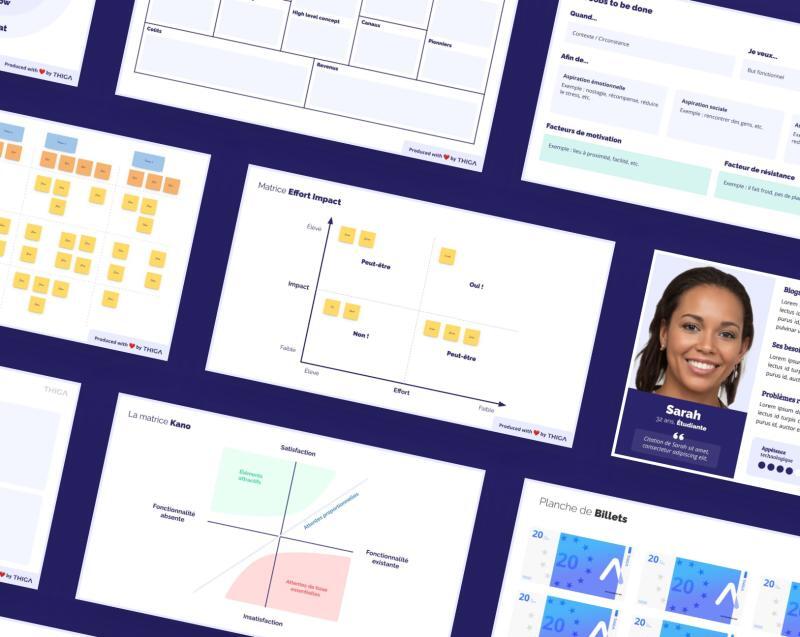

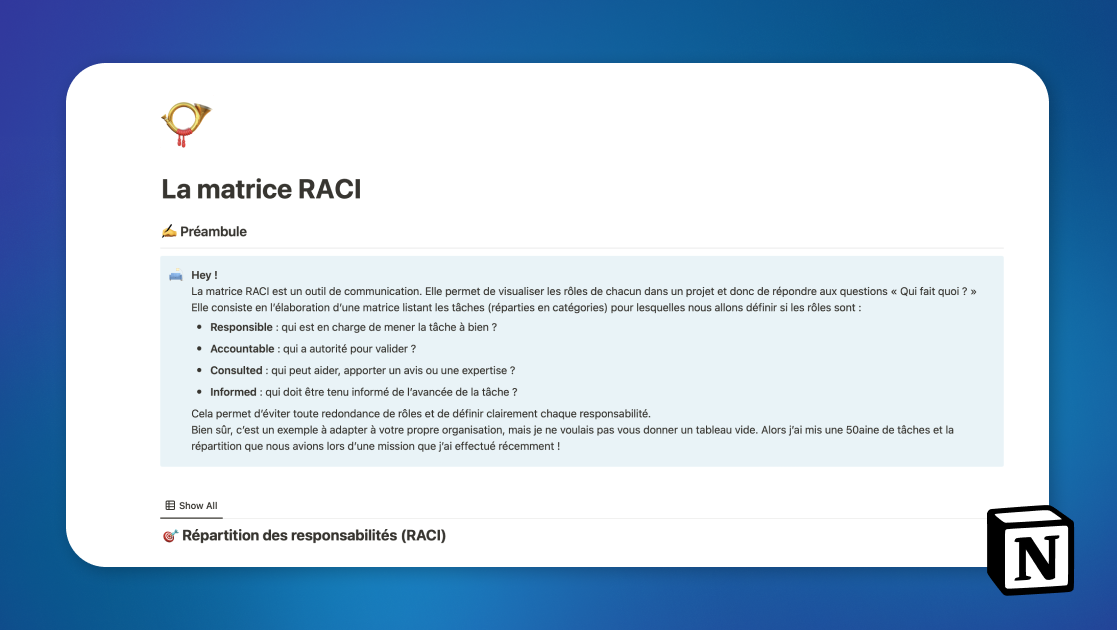

- Cadrage de solution : un AI PRD template conçu pour les produits probabilistes. Il vous force à définir ce que "bon" veut dire pour votre feature, à justifier le recours au LLM, et à poser vos critères de qualité avant d'écrire une ligne de code.

- Constitution du golden dataset : les exemples de référence qui serviront de boussole tout au long du cycle de vie de la feature, et de base pour vos tests de régression.

- Développement & amélioration : analysez les interactions entrées/sorties, évaluez les avantages et limites de chaque approche, et intégrez l'observabilité dès le développement.

- Évaluation hors ligne : configurez votre LLM-as-a-Judge, définissez vos rubriques d'évaluation et itérez jusqu'à atteindre le seuil de qualité que vous avez fixé.

Une fois en production, mettez en place une boucle d'amélioration continue :

- Évaluations en continu : combinez annotation manuelle et LLM-as-a-Judge sur des données réelles pour maintenir la qualité dans le temps et détecter les dérives silencieuses.

- Observabilité : suivez vos traces, scores d'évaluation, coûts des modèles et versioning des prompts. Sans ça, le debugging devient de l'archéologie.

- Failure hunting : au-delà des évaluations automatisées, organisez des sessions de revue humaine pour découvrir les nouveaux modes d'échec avant qu'ils deviennent des plaintes utilisateurs.

- Mesure d'impact : reliez vos métriques techniques aux indicateurs business (adoption, rétention, satisfaction) pour piloter vos décisions avec les bons signaux.

.jpg?width=2000&name=shutterstock_673044232%20(1).jpg)

Pourquoi utiliser l'AI Eval Playbook :

-

Couvrez tout le cycle de vie de l'IA

La plupart des ressources sur le sujet s'arrêtent à l'évaluation hors ligne. Avec le Playbook, couvrez tout le cycle de vie de vos features IA, du cadrage jusqu'au monitoring en production.

-

Automatisez vos évaluations à l'échelle

Évaluer manuellement chaque sortie de votre LLM n'est pas tenable. Le framework vous permet d'utiliser un LLM pour juger les sorties d'un autre, combiné à l'annotation humaine sur les cas critiques pour un maximum de fiabilité.

-

Connectez intelligence artificielle et business

Un bon score d'évaluation technique ne suffit pas si la feature n'est pas adoptée. Le Playbook relie vos métriques d'évaluation à vos indicateurs business : adoption, rétention, satisfaction.

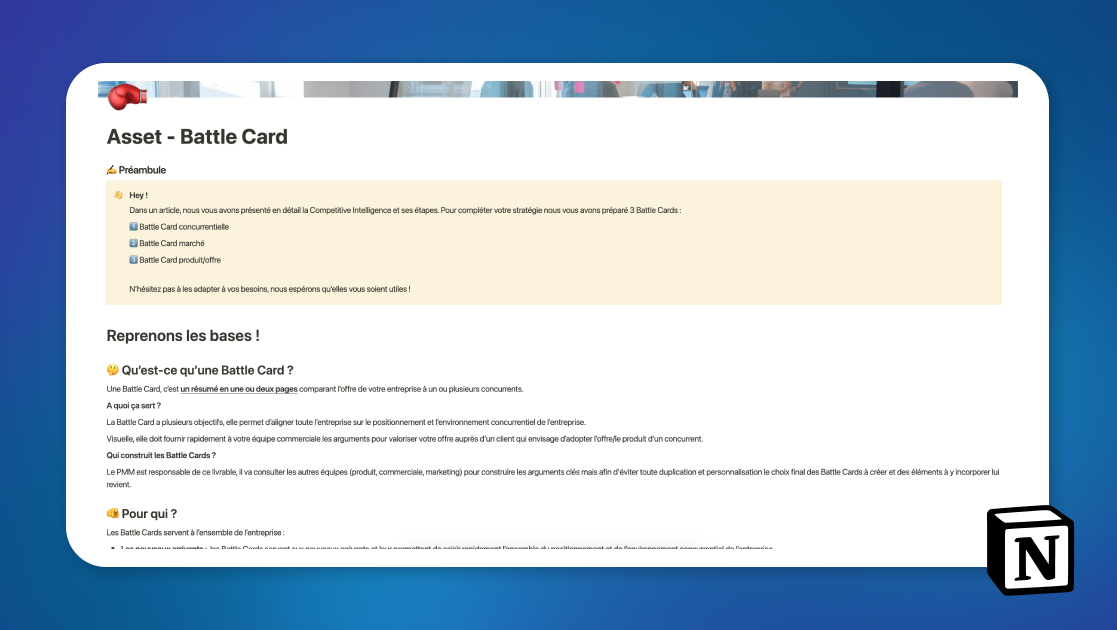

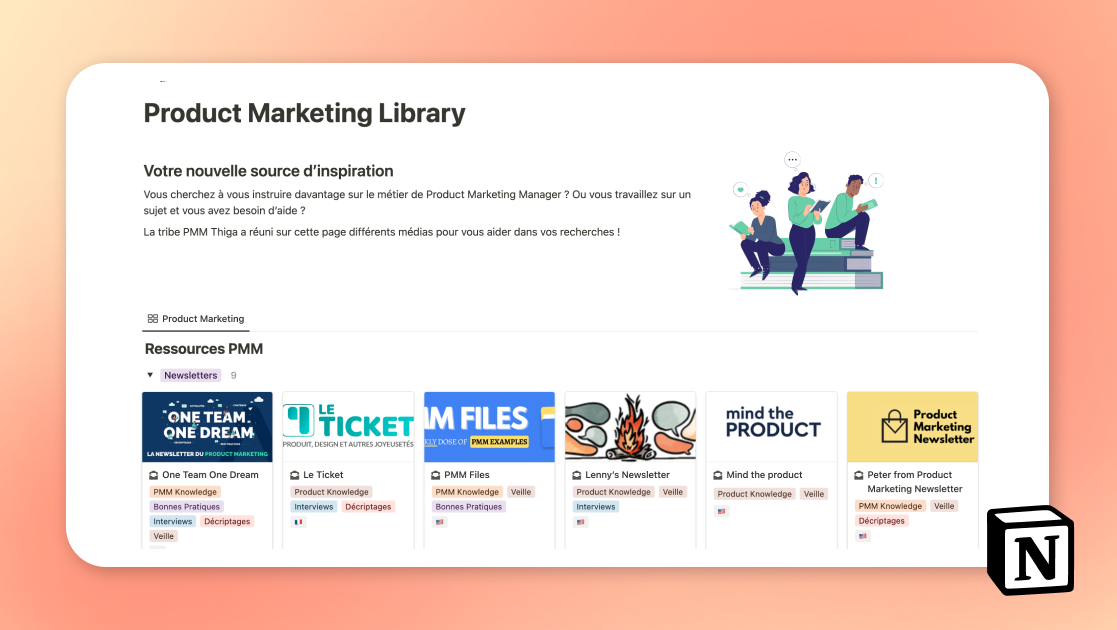

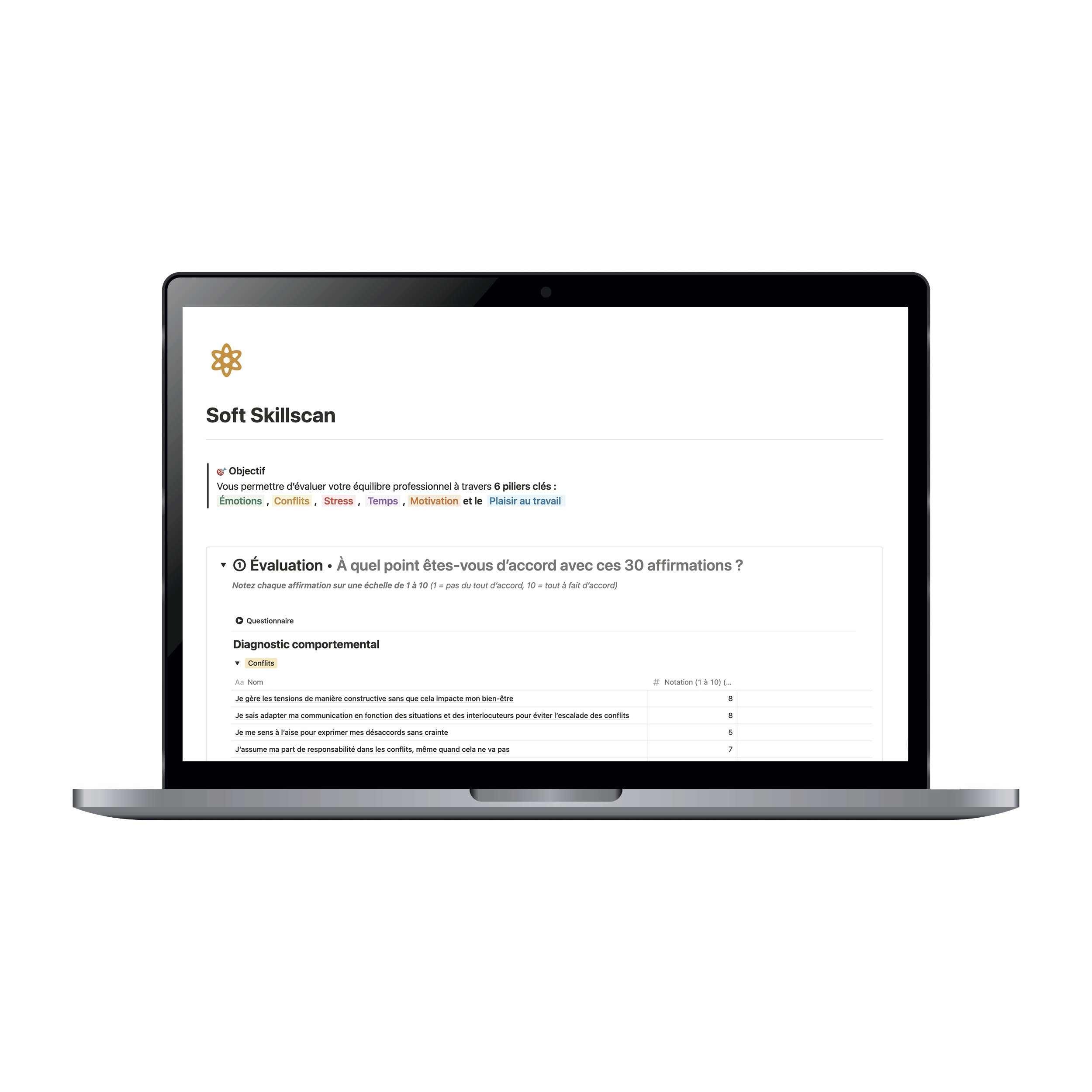

Nos autres assets

Nous contacter

Échangeons ensemble sur vos enjeux produit et découvrons comment nous pouvons vous accompagner.

Thiga

The newsletter with real impact

.png)

-1.webp)

.webp)